Massenhafte KI-gestützte Videoüberwachung in der Frankfurter Innenstadt

Die Polizei setzt in Frankfurt biometrische Echtzeit-Videoüberwachung im öffentlichen Raum ein. Dabei erfasst und analysiert sie mittels künstlicher Intelligenz die Daten aller Personen im Blickfeld der Kameras. Eine derart umfassende Überwachung greift unzulässig tief in Grundrechte wie die Privatsphäre ein. Deshalb klagen wir vor dem Verwaltungsgericht Frankfurt am Main.

Anhand biometrischer Daten lässt sich eine Person über Merkmale ihres Körpers oder ihres Verhaltens eindeutig identifizieren. Seit Juli 2025 testet die hessische Polizei im Frankfurter Bahnhofsviertel biometrische Echtzeit‑Gesichtserkennung. Mit sechs KI‑gestützten Kameras erfasst sie dort Gesichtszüge und Bewegungen von Menschen im öffentlichen Raum und gleicht sie in Echtzeit mit polizeilichen Datenbanken ab. So will die Polizei Personen identifizieren, von denen terroristische Gefahren ausgehen. Sie will aber auch vermisste Personen und Opfer von Entführung, Menschenhandel oder sexueller Ausbeutung finden. Die Polizei hat den Einsatz dieses KI-Systems nun auf zwei weitere Orte in der Innenstadt ausgedehnt – und es ist damit zu rechnen, dass weitere Standorte folgen.

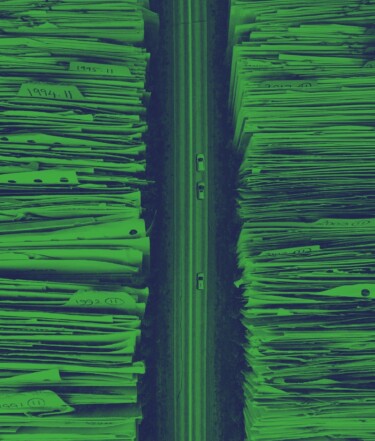

Die KI erfasst gesuchte und nicht gesuchte Personen gleichermaßen. Um eine bestimmte Person zu identifizieren, muss das System zwangsläufig zunächst alle gefilmten Personen mit Referenzdaten abgleichen. So werden alle, die ins Kamerafeld geraten, biometrisch erfasst – und zwar noch bevor feststeht, ob überhaupt ein Bezug zu einer Fahndung besteht. Damit verarbeitet die Polizei massenhaft hoch sensible Daten unbeteiligter Menschen.

Wenn Überwachung Hilfe erschwert

Eine der Kameras ist direkt auf den Hauseingang der Beratungsstelle von Doña Carmen e. V. gerichtet. Sexarbeiter*innen suchen dort niedrigschwellig Hilfe bei sozialen, rechtlichen und gesundheitlichen Fragen – und das häufig in akuten Notlagen.

Schon bevor sie das Gebäude betreten, erfasst eine gegenüberliegende Kamera ihre biometrischen Merkmale. Für Menschen in schwierigen Lebenslagen kann das bedeuten, dass sie sich aus Angst oder Scham gar nicht erst trauen, Hilfe zu suchen. Für eine Beratungsstelle, die auf Vertrauen und Vertraulichkeit angewiesen ist, ist das ein großes Problem. Besonders betroffen sind Menschen, die sexualisierte Gewalt oder Ausbeutung erfahren haben: also genau diejenigen, die die Überwachung eigentlich schützen soll.

„Frauen, die bei uns Rat und Unterstützung suchen, ist ihre Anonymität sehr wichtig. Sie fühlen sich durch permanente Überwachung eingeschüchtert und verunsichert. Das gilt auch für Beschäftigte und Mitglieder unseres Vereins. Die Technologie soll eigentlich vor Kriminalität schützen, nicht aber Frauen davon abhalten, sich beraten zu lassen.“

Wer beobachtet wird, verhält sich anders

Weil das Bahnhofsviertel als „Problembezirk“ gilt, dient es als Einfallstor für massenhafte Überwachung. Doch die biometrische Erfassung betrifft nicht nur Gesuchte, sondern vor allem all jene, die sich dort täglich bewegen. Für die Betroffenen ist dabei nicht erkennbar, wann die KI-Funktion der Kameras aktiv ist. So lässt sich weder vorhersehen noch kontrollieren, wann die Polizei eine Person erfasst.

Das Bundesverfassungsgericht hat die Einschüchterungseffekte ähnlicher Überwachungsmaßnahmen in seiner Rechtsprechung wiederholt als grundrechtsgefährdend bezeichnet. Wenn Menschen nicht wissen, ob und wann sie biometrisch erfasst werden, ändern sie ihr Verhalten: Sie verzichten etwa auf Demonstrationen und meiden bestimmte Orte. Gesellschaftliche Teilhabe hängt dann davon ab, ob eine Person bereit ist, sich überwachen zu lassen. Hinzu kommt das Risiko, dass der Staat die erfassten Daten mit anderen Informationen verknüpft – damit könnten Behörden etwa Bewegungsprofile erstellen, die weitreichende Rückschlüsse auf das Leben der Menschen ermöglichen.

Fehleranfälligkeit und Diskriminierungsrisiken

Dass die Technik fehleranfällig ist, verschärft das Problem: KI-Systeme zur Gesichtserkennung übernehmen Verzerrungen aus ihren Trainingsdaten. Studien belegen, dass die Technologie Frauen, Kinder und People of Colour häufig schlechter erkennt. Diese sind damit einem höheren Risiko ausgesetzt, Ziel polizeilicher Anschlussmaßnahmen zu werden. Dadurch drohen willkürliche polizeiliche Maßnahmen – bis hin zu rechtswidrigen Festnahmen.

Forschende beobachten zudem die sogenannte Decision Fatigue (Entscheidungsmüdigkeit) bei der Polizei: Auch wenn weiterhin Beamt*innen nach jedem Treffer der KI über das weitere Vorgehen entscheiden müssen, verlassen sie sich zunehmend unkritisch auf die vermeintlich zuverlässige und neutrale Technik. Die Intransparenz dieser Systeme verstärkt das Problem. Wer von einer Fehlidentifikation betroffen ist, kann die Entscheidungslogik nicht nachvollziehen und sich kaum wirksam dagegen wehren.

Für schwere Grundrechtseingriffe braucht es strenge gesetzliche Grenzen

Biometrische Daten verdienen besonderen Schutz, weil sie eine Person eindeutig und dauerhaft identifizieren können. Ihre anlasslose Erfassung ist daher ein besonders schwerer Eingriff in das Recht, über die eigenen Daten zu bestimmen.

Solche Eingriffe sind nicht grundsätzlich verboten, erfordern aber eine klare und verhältnismäßige gesetzliche Grundlage, die verbindliche Grenzen festlegt. Die aktuelle Rechtsgrundlage im hessischen Polizeirecht (Paragraph 14 des Hessischen Sicherheits- und Ordnungsgesetzes) erfüllt diese Anforderungen nicht: Sie ist zu weit gefasst und erlaubt den Einsatz auch für Zwecke, die nicht der Abwehr von besonders großen Gefahren dienen. Zusätzlich muss die biometrische Echtzeitüberwachung den strengen Vorgaben der europäischen KI-Verordnung genügen – auch das ist in Hessen nicht der Fall.

Ein Grundsatzurteil, bevor die Überwachung zur Normalität wird

Mit unserer Klage wollen wir zunächst eine Vorlage an das Bundesverfassungsgericht erreichen. Dieses soll verbindliche Maßstäbe für den Einsatz biometrischer Videoüberwachung aufstellen und die zu weit gefasste hessische Rechtsgrundlage teilweise für verfassungswidrig erklären. Darüber hinaus möchten wir eine Überprüfung durch den Europäischen Gerichtshof erwirken. Der EuGH soll die einschlägigen Vorschriften der europäischen KI-Verordnung konkretisieren.

Hessen ist das erste Bundesland, das die biometrische Fernidentifizierung gesetzlich ermöglicht und in der Praxis erprobt hat. Es wird jedoch nicht das letzte sein: Niedersachsen, Sachsen und Schleswig-Holstein haben bereits entsprechende Gesetzentwürfe vorgelegt. Die Frage, welche Grenzen der Staat beim Einsatz biometrischer Überwachung einhalten muss, wird an Relevanz gewinnen.